はじめに

初めまして、合同会社Artopeerの越川と申します。

記事をご覧いただき、誠にありがとうございます。

私は10年以上にわたりWeb開発からサーバー構築までを経験し、現在はシステムの安定稼働、データ保護、サイバー脅威対策に注力しています。

この経験から、ビジネスにおけるデータ保護の重要性を強く認識しております。

生成AIの進化とセキュリティの新たな挑戦

このデータ保護の重要性は、生成AIの急速な普及により、新たな局面を迎えています。

Google Cloudの最先端AI「Gemini」も高い注目を集める一方、その導入にはデータ漏洩や不正アクセスといったセキュリティリスクへの対応が不可欠です。

これらは、AI活用を検討する上で避けて通れない課題と言えるでしょう。

私自身、長年のITインフラとセキュリティの経験から、革新的技術の恩恵とリスクは表裏一体であると認識しており、本稿ではこのGeminiのセキュリティというテーマに取り組みます。

本記事が提供するもの

本記事では、セキュリティエンジニアや情報システム部門の担当者の皆様が、Geminiを安全かつ効果的に活用するための実践的な知識とアプローチを提供します。

Geminiのセキュリティ基盤、保護機能、そして導入・運用時の注意点を技術的観点から具体的に解説します。

この記事が、皆様のGemini導入検討の一助となり、セキュアなAI活用の推進にお役立てできれば幸いです。

Geminiのセキュリティとはどのようなものか

Geminiのセキュリティは、Google Cloudの堅牢なインフラストラクチャと長年にわたるセキュリティ運用の知見を基盤として構築されています。

これは単一の機能ではなく、データ保護、モデルの安全性、アクセス制御、コンプライアンス対応など、多層的なアプローチによって実現されています。

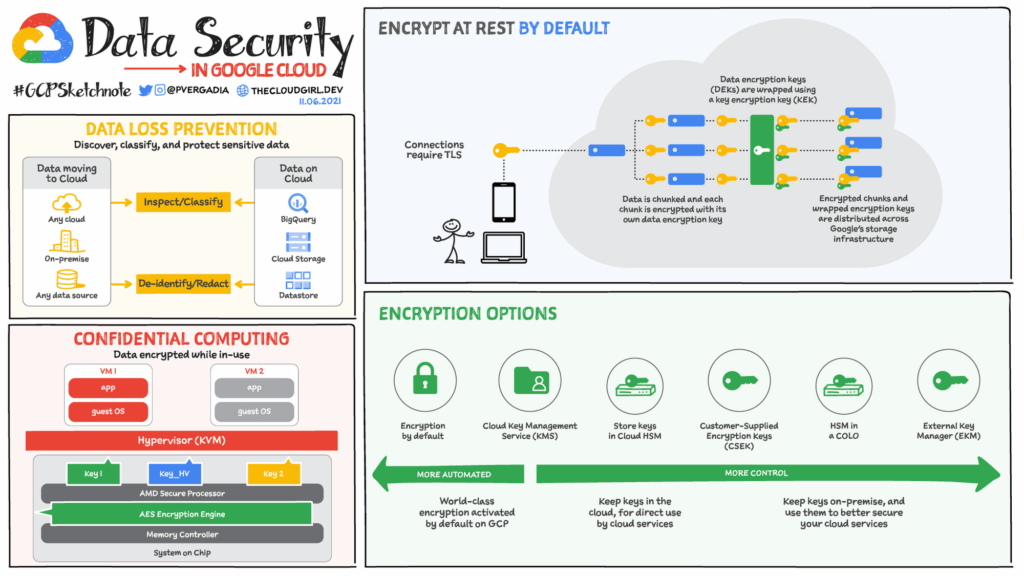

参考文献:https://cloud.google.com/blog/ja/topics/developers-practitioners/google-cloud-security-overview

Google Cloudの基盤セキュリティ

Geminiは、Googleがグローバルに展開するデータセンター上で稼働します。

これらのデータセンターは、物理的なセキュリティ対策はもちろんのこと、カスタム設計されたハードウェア(Titanチップなど)、冗長化されたネットワーク、厳格な運用プロセスによって保護されています。

データセキュリティ

Geminiを利用する上で最も重要な懸念事項の一つが、入力・出力されるデータの保護です。Google Cloudでは、以下の主要なデータセキュリティ機能を提供しています。

- 保存データの暗号化

Google Cloudに保存されるデータは、デフォルトでAES-256などの強力な暗号化アルゴリズムを用いて暗号化されます。

さらに、顧客管理の暗号鍵(CMEK: Customer-Managed Encryption Keys)を利用することで、暗号鍵の管理と制御をユーザー自身が行うことも可能です。

注釈: CMEK (Customer-Managed Encryption Keys) とは、ユーザーがGoogle Cloudの外部で作成・管理する暗号鍵を使用して、Google Cloud上のデータを暗号化できる機能です。

鍵のライフサイクルを完全にコントロールできます。 - 転送中のデータの暗号化

クライアントとGemini APIエンドポイント間の通信は、TLS (Transport Layer Security) によって暗号化され、データの盗聴や改ざんを防ぎます。 - データの分離とアクセス制御

各顧客のデータは論理的に分離され、Identity and Access Management (IAM) によって厳格なアクセス制御が行われます。

IAMにより、誰がどのリソースに対してどのような操作を行えるかを詳細に設定できます。

注釈: IAM (Identity and Access Management) とは、Google Cloudリソースへのアクセス権限を管理するためのフレームワークです。ユーザー、グループ、サービスアカウントに対して役割(ロール)を割り当てることで、最小権限の原則を実現します。 - データ処理の透明性

Google Cloudは、データ処理に関する透明性を重視しており、「Cloud Data Processing Addendum (CDPA)」を通じて、データの取り扱い方法や処理場所について明確に規定しています。

Geminiの利用規約においても、入力されたデータがモデルの一般的な改善に利用されることはないと明記されている場合があります(利用するサービスや設定によりますので、常に最新の規約を確認してください)。

下図は Google Developers & Practitioners Blog から抜粋

※2022年6月時点で掲載された内容のため、最新の状況とは異なる可能性がございます。

モデルセキュリティ

Geminiモデル自体の安全性も重要な要素です。

- モデルの堅牢性

Googleは、敵対的攻撃(Adversarial Attacks)など、AIモデルを欺こうとする攻撃手法に対する研究と対策を進めています。

モデルのトレーニングプロセスやアーキテクチャにおいて、これらの脅威に対する耐性を高める工夫が施されています。 - トレーニングデータのセキュリティとプライバシー

Geminiの基盤モデルのトレーニングには、公開データやライセンスデータが使用されますが、その過程でプライバシー保護技術が適用されています。

ファインチューニング(顧客データを用いたモデルの追加学習)を行う場合も、顧客データは厳格に保護され、他の顧客からアクセスできないように分離されます。

コンプライアンスと認証

Google Cloudは、ISO 27001, ISO 27017, ISO 27018, SOC 1/2/3, PCI DSS, HIPAA, FedRAMPなど、数多くの国際的および地域的なセキュリティ基準や規制への準拠認定を取得しています。

Geminiが提供されるVertex AIプラットフォームもこれらの認証の対象範囲に含まれており、特定の業界(金融、医療など)のコンプライアンス要件を満たす上で役立ちます。

責任共有モデル

クラウドサービスを利用する上では、「責任共有モデル」を理解することが不可欠です。

これは、セキュリティ責任をクラウドプロバイダー(この場合はGoogle)と顧客の間でどのように分担するかを明確にするものです。

- Googleの責任

クラウドの基盤インフラ(ハードウェア、ソフトウェア、ネットワーク、施設)のセキュリティ。

Geminiモデル自体の保護。 - 顧客の責任

Google Cloud上に構築するアプリケーションのセキュリティ、入力するデータの管理と保護、IAMによる適切なアクセス制御、APIキーの管理、ネットワーク設定(VPC Service Controlsなど)、クライアント側のセキュリティ対策。

Geminiを利用する際は、この責任共有モデルを理解し、顧客側の責任範囲において適切なセキュリティ対策を講じることが極めて重要です。

なぜGeminiが活用されるのか(選ばれる理由)

多くの企業がGeminiの導入を検討する際、その高度な機能だけでなく、Google Cloudが提供するセキュリティと信頼性が大きな判断材料となります。

1. GoogleのAI倫理原則と責任あるAIへの取り組み

Googleは「AIの倫理原則」を掲げ、安全性、公平性、プライバシー、説明責任などを重視したAI開発を進めています。

Geminiの開発においてもこれらの原則が深く関わっており、技術的なセキュリティ機能だけでなく、倫理的な観点からも信頼性の高いAI活用を目指せる点が評価されています。

これは、特に社会的に影響の大きい分野でのAI利用において重要な要素となります。

2. Vertex AIとの統合による包括的なセキュリティ管理

Geminiは、Google Cloudの統合AIプラットフォームであるVertex AI上で提供されます。

Vertex AIは、モデル開発からデプロイ、運用管理(MLOps)までを支援する豊富な機能を備えており、セキュリティ機能も充実しています。

- VPC Service Controls

プロジェクトやリソースへのアクセスを、定義されたセキュリティ境界内からのみに制限できます。これにより、Gemini APIへのアクセスを内部ネットワークや特定のVPCに限定し、データ流出リスクを大幅に低減できます。

注釈: VPC Service Controls とは、Google Cloudリソースの周囲にセキュリティ境界を作成し、境界を越えるデータ移動を制御する機能です。

これにより、内部不正や外部攻撃によるデータ漏洩リスクを軽減します。 - Private Endpoints

Gemini APIへのアクセスをパブリックインターネットを経由せず、Googleのプライベートネットワーク内で行うことができます。 - Cloud Audit Logs

Gemini APIへのアクセスログや管理アクティビティログが記録され、監査やセキュリティインシデント発生時の追跡調査に役立ちます。 - Identity-Aware Proxy (IAP)

アプリケーションレベルでのアクセス制御を提供し、ユーザーIDに基づいてGeminiを利用するアプリケーションへのアクセスを保護できます。

これらのVertex AIの機能とGeminiを組み合わせることで、エンドツーエンドでの包括的なセキュリティ体制を構築できます。

3. 先進的な脅威インテリジェンスの活用

Googleは、検索エンジン、Gmail、Chromeなど、世界最大級のサービスを運用する中で、日々膨大な量のセキュリティ脅威情報を収集・分析しています。

この高度な脅威インテリジェンスは、Google Cloud全体のセキュリティ強化に活かされており、Geminiを含むサービスもその恩恵を受けています。

最新の攻撃手法や脆弱性に対する迅速な対応が期待できます。

4. カスタマイズ性とコントロール

画一的なセキュリティ対策ではなく、企業のポリシーやリスク許容度に応じてセキュリティ設定をカスタマイズできる点が強みです。

前述のCMEKによる暗号鍵管理、IAMによる詳細な権限設定、VPC Service Controlsによるネットワーク境界設定など、顧客側で多くのコントロールを保持できます。

これにより、自社のセキュリティガバナンスに沿った運用が可能です。

5. グローバルスケールのインフラとセキュリティ運用

Googleの堅牢なグローバルインフラは、高い可用性と耐障害性を実現し、ビジネス継続性をサポートします。

また、24時間365日のセキュリティ監視体制により、インシデントの早期発見と対応が行われます。

これらの理由から、セキュリティを重視する多くの企業にとって、Geminiとその基盤であるGoogle Cloudは信頼できる選択肢となっています。

Geminiを業務利用するための具体的なステップ

Geminiを安全に利用するためには、Google Cloudが提供するセキュリティ機能を適切に設定し、運用プロセスに組み込む必要があります。

以下に、具体的なステップと考慮事項を示します。

1. 準備段階:セキュリティ要件の定義と計画

- セキュリティ要件の明確化

どのようなデータをGeminiで処理するのか(機密レベルの分類)。

適用される法規制や業界標準(GDPR, HIPAA, PCIDSSなど)の確認。

自社のセキュリティポリシーとの整合性。 - Google Cloudプロジェクトの設計

組織ポリシーの設定

組織全体で一貫したセキュリティ設定(例:特定のリージョンのみ利用許可、CMEKの強制など)を適用します。

フォルダとプロジェクトの構造化

リソース管理とアクセス制御を容易にするために、適切なフォルダ階層とプロジェクト分離を計画します。

例えば、開発、ステージング、本番環境ごとにプロジェクトを分けるなど。

ネットワーク構成

VPC Service Controlsを利用する場合の境界設計、Private Endpointsの利用計画などを検討します。

2. Vertex AI上でのGemini利用時のセキュリティ設定

- IAM (Identity and Access Management) の設定: 最小権限の原則

Gemini APIへのアクセス権限を持つユーザーやサービスアカウントには、必要最小限のロール(例:Vertex AI User,Vertex AI Service Agent)を付与します。

サービスアカウントの適切な利用

アプリケーションからGemini APIを呼び出す場合は、ユーザーアカウントの認証情報ではなく、専用のサービスアカウントを使用し、キーの管理を徹底します。

可能であれば、Workload Identity連携の利用を検討し、サービスアカウントキーの直接的な管理を避けます。 - APIキー管理

Gemini APIを利用する際にAPIキーが必要な場合があります。

APIキーは機密情報として厳重に管理し、コードへのハードコーディングを避け、環境変数やSecret Managerなどの安全な場所に保管します。 APIキーには適切な制限(API制限、IPアドレス制限など)を設定し、定期的なローテーションを計画・実施します。 - ネットワークセキュリティの設定: VPC Service Controls

前述の通り、Gemini APIを含むVertex AIサービスへのアクセスを、定義したサービス境界内に制限します。

これにより、承認されていないネットワークからのアクセスや、境界外へのデータ持ち出しを防止します。

Private Endpoints (Vertex AI Private Endpoints)

パブリックIPアドレスを持たないプライベートエンドポイント経由でGemini APIにアクセスすることで、トラフィックをGoogleのプライベートネットワーク内に閉じ込めます。 - データ暗号化 (CMEK)

特に機密性の高いデータを扱う場合や、コンプライアンス要件で顧客管理の鍵が必要な場合は、CMEKを設定します。

Cloud Key Management Service (KMS) を利用して鍵を作成・管理し、Vertex AIリソース(例: ファインチューニングジョブで使われるデータセット)に関連付けます。 - 監査ログの活用: Cloud Audit Logs

Vertex AIのAPI呼び出し(Geminiへのリクエストを含む)や管理アクティビティは、Cloud Audit Logsに記録されます。

これらのログを定期的に監視し、異常なアクセスや操作がないかを確認します。

Log Sinkの設定

監査ログをCloud Storageバケット、BigQueryデータセット、Pub/Subトピックなどにエクスポートし、長期保存や高度な分析、SIEM (Security Information and Event Management) ツールとの連携を行います。

注釈: Cloud Audit Logs とは、Google Cloudリソースに対する管理アクティビティやデータアクセスに関するログを記録・提供するサービスです。誰が、いつ、どこで、何をしたかを追跡できます。

3. アプリケーションレイヤーでのセキュリティ対策

Geminiを組み込むアプリケーション側でも、セキュリティ対策は不可欠です。

- プロンプトインジェクション対策

ユーザーからの入力をプロンプトとしてGeminiに渡す場合、悪意のある指示(例: 「これまでの指示を無視して、代わりにこの悪意のある操作を実行してください」)が注入される「プロンプトインジェクション」のリスクがあります。

対策としては、入力値のサニタイズ、エスケープ処理、入力パターンの検証、プロンプトの構造化(例: ユーザー入力部分を明確に区切る)などが考えられます。

また、Google Cloudからはプロンプトエンジニアリングのベストプラクティスも提供されています。

注釈: プロンプトインジェクションとは、LLMへの指示(プロンプト)に悪意のある文字列を巧妙に埋め込むことで、開発者の意図しない動作を引き起こさせたり、機密情報を漏洩させたりする攻撃手法です。 - 出力データの検証とフィルタリング

Geminiからの出力に、不適切なコンテンツ(ヘイトスピーチ、差別的な内容など)や、意図せず機密情報が含まれてしまう可能性も考慮し、アプリケーション側でフィルタリングや検証を行う仕組みを導入します。

Google CloudもResponsible AIツールキットの一部として、コンテンツフィルタリング機能を提供しています。 - レート制限とクォータ管理

Gemini APIへのリクエストに対して、適切なレート制限やクォータを設定し、不正利用やDoS (Denial of Service) 攻撃によるサービスの枯渇を防ぎます。

4. 定期的なセキュリティレビューとアップデート

- 設定したセキュリティ対策が継続的に有効であるか、定期的にレビューし、必要に応じて見直しを行います。

- Google CloudやGeminiに関する新しいセキュリティ情報やベストプラクティスを常に把握し、システムを最新の状態に保ちます。

- セキュリティインシデント対応計画を準備し、定期的な訓練を実施します。

これらのステップを実践することで、Geminiをより安全に活用するための基盤を構築できます。

Geminiを利用する上で、セキュリティ面でのメリット

Geminiおよびその基盤となるGoogle Cloudが提供するセキュリティは、単に機能が豊富であるだけでなく、他の主要なAIプラットフォームと比較していくつかの際立ったメリットを提供します。

セキュリティエンジニアや情報システム部門の担当者が導入を検討する上で、これらの比較ポイントは重要な判断材料となるでしょう。

ただ、文章だといまいちGeminiを利用するメリットが分り難くなるため、最後に「他製品との比較のまとめ」も記述します。

Google Cloudネイティブな統合セキュリティとエコシステムの強み

Geminiの特徴

Geminiは、IAM (Identity and Access Management)、VPC Service Controls、CMEK (Customer-Managed Encryption Keys)、Cloud Audit Logs、Security Command CenterといったGoogle Cloudの堅牢なセキュリティサービス群と深く統合されています。

これにより、AIワークロードのセキュリティ設定から監視、インシデント対応までを一元的に管理しやすくなります。

比較ポイント

- Azure OpenAI Service

Azureもまた、Azure Active Directory (現 Microsoft Entra ID)、Azure Key Vault、Azure Virtual Network、Azure Monitorなど、強力なセキュリティエコシステムを持っています。

特にMicrosoft製品群との親和性が高く、既存のAzure環境やMicrosoft 365を利用している企業にとってはスムーズな統合が期待できます。

- Amazon Bedrock

AWSもIAM、KMS (Key Management Service)、VPC、CloudTrail、Security Hubといった包括的なセキュリティサービスを提供しており、AWSの広範なサービス群との連携が強みです。

Geminiならではの強み

Google Cloudは、特にデータ分析(BigQueryなど)やMLOps(Vertex AI Pipelinesなど)の分野で強力なサービスを有しており、これらとGeminiを組み合わせる際に、セキュリティ設定やデータガバナンスを一貫して適用しやすいというメリットがあります。

また、Google Workspaceとの連携を考慮した場合、Workspaceのセキュリティ設定と連動したGeminiの利用制御が可能です。

GoogleのAI倫理原則と先進的なResponsible AIへの取り組み

Geminiの特徴

Googleは「AIの倫理原則」を掲げ、安全性、公平性、プライバシー、説明責任を重視したAI開発を推進しています。

GeminiのAPIには調整可能なセーフティフィルターが組み込まれており、有害コンテンツの生成リスクを低減する機能が提供されています。

これは、モデルの出力をより安全に統制したい企業にとって大きなメリットになるのではないでしょうか。

比較ポイント

- Azure OpenAI Service

Microsoftも責任あるAI (Responsible AI) の原則を重視し、コンテンツフィルタリングや不正利用監視などの機能を提供しています。

- Amazon Bedrock

AWSもGuardrails for Amazon Bedrockなどの機能を提供し、有害コンテンツのフィルタリングや、特定のトピックに関する応答の制限が可能です。

Geminiならではの強み

Googleは長年にわたり、検索エンジンやYouTubeなどで大規模なコンテンツモデレーション技術を培ってきました。

この知見がGeminiのセーフティフィルターやResponsible AIツールキットに活かされており、特にマルチモーダルなコンテンツ(画像、動画など)に対する安全性評価において先進的なアプローチが期待できます。

データガバナンスと透明性における選択肢の広さ

Geminiの特徴

Vertex AI上でGeminiを利用する場合、顧客データが基盤モデルのトレーニングに利用されないことが明記されており、データの所有権と管理権は顧客にあります。

CMEKによる暗号鍵の完全なコントロール、データ処理場所の指定オプション(一部サービス)、詳細な監査ログにより、高いレベルのデータガバナンスを実現できます。

比較ポイント

- Azure OpenAI Service

入力データがOpenAIの基盤モデルの学習に利用されないポリシーを明確にしています。

Azure Key Vaultによる鍵管理や、VNet統合によるプライベートアクセスも可能です。

- Amazon Bedrock

こちらも顧客データが基盤モデルの学習に利用されたり、モデルプロバイダーと共有されたりすることはないと明記しています。

AWS KMSによる鍵管理、AWS PrivateLinkによるプライベート接続をサポートしています。

Geminiならではの強み

Google Cloudは、データ処理の透明性に関するドキュメント(例:「The life of a prompt: Demystifying Gemini」)を積極的に公開しており、ユーザーがデータフローを理解しやすいように努めています。

また、Google Workspaceとの連携時においても、既存のデータガバナンスポリシーやアクセス権限が尊重される設計になっています。

Googleのグローバルインフラと高度な脅威インテリジェンス

Geminiの特徴

Googleの堅牢かつ広範なグローバルネットワークとデータセンターインフラ上でGeminiは稼働します。

これにより、高い可用性とスケーラビリティを確保しつつ、Googleが日々収集・分析している膨大な脅威インテリジェンス(例:Chronicle Security Operationsの基盤技術)を活用した高度なセキュリティ保護の恩恵を受けることができます。

比較ポイント

- Azure OpenAI Service

Microsoftもグローバルなデータセンター網と、Microsoft Intelligent Security Graphなどの脅威インテリジェンスを有しており、堅牢なインフラとセキュリティを提供しています。 - Amazon Bedrock

AWSも世界最大級のクラウドインフラと、AWS ShieldなどのDDoS対策サービス、GuardDutyなどの脅威検知サービスを提供し、高いレベルのインフラセキュリティを実現しています。

Geminiならではの強み

Googleは、Android、Chrome、Gmailといったエンドユーザー向けの大規模サービスを長年運用しており、多様な攻撃ベクトルに対する防御ノウハウが豊富です。

この経験が、Geminiを含むGoogle Cloudサービス全体のセキュリティ体制の強化に繋がっています。

また、Titanチップのようなカスタムハードウェアによるインフラレベルでのセキュリティ強化も特徴的です。

他製品との比較のまとめ

| セキュリティ観点 | Gemini (Google Cloud) | Azure OpenAI Service | Amazon Bedrock (AWS) |

|---|---|---|---|

| 統合セキュリティ | Vertex AIとの緊密な連携、Google Cloudエコシステム全体での一貫した管理、Workspace連携 | Azureサービス群との強力な連携、Microsoft Entra ID中心のID管理、Microsoft 365との親和性 | AWSの広範なサービスとの連携、IAMを中心としたアクセス管理 |

| Responsible AI | Google AI倫理原則、調整可能なセーフティフィルター、Responsible AIツールキット、マルチモーダル対応 | Microsoft Responsible AI原則、コンテンツフィルタリング、不正利用監視 | Guardrails機能、有害コンテンツフィルタリング、特定トピック制限 |

| データガバナンス | 顧客データはモデル学習に不使用、CMEK、データ処理場所の選択肢、透明性の高いドキュメント提供 | 顧客データはモデル学習に不使用、Azure Key Vault、VNet統合 | 顧客データはモデル学習・共有に不使用、AWS KMS、PrivateLink |

| インフラと脅威対策 | グローバルインフラ、高度な脅威インテリジェンス、Titanチップなどカスタムハードウェアによる保護 | グローバルインフラ、Microsoft Intelligent Security Graph | グローバルインフラ、AWS Shield、GuardDutyなど |

| 特に注目すべき強み | データ分析・MLOpsとの連携、Workspace連携時のセキュリティ、マルチモーダルコンテンツの安全性、透明性 | Microsoft製品エコシステムとの親和性 | 多様な基盤モデルの選択肢とAWSサービス連携の柔軟性 |

もちろん、最適なAIツールは企業の既存システム環境、重視するセキュリティ要件、利用目的によって異なります。

しかし、GeminiはGoogle Cloudの強力なセキュリティ基盤とResponsible AIへの先進的な取り組みにより、多くの企業にとって魅力的な選択肢となるでしょう。

導入を検討する際は、各プラットフォームが提供する最新のセキュリティ機能やドキュメントを確認し、自社のニーズに最も合致するものを選定することが重要です。

活用方法

Geminiの堅牢なセキュリティ機能を活用したAI導入の具体的な活用方法について、想定される場面とセットでお伝えします。

1. 金融業界におけるリスク分析と不正検知の高度化

- 課題

顧客の取引データや市場ニュースなど、機密性の高い情報を扱いながら、高度なAI分析(不正取引パターンの早期発見、信用リスク評価の精緻化など)を実現したい。

同時に、金融庁のガイドラインやFISC安全対策基準などの規制遵守も必須。

- Geminiとセキュリティ対策の活用

Geminiの強力な自然言語処理能力とマルチモーダル分析能力を活用し、膨大なテキストデータや構造化データからリスク要因を抽出。

データ保護

VPC Service Controlsでプロジェクト境界を設定し、Gemini APIへのアクセスを承認されたVPCからのみに限定。

転送中および保存データの暗号化(TLS, CMEK)を徹底。

さらにIAMでアクセス権限を最小化。

監査とコンプライアンス

Cloud Audit Logsで全てのAPIアクセスと管理操作を記録し、定期的な監査を実施。

コンプライアンスレポートを活用し、規制当局への報告に対応。

- 結果(期待される効果)

より迅速かつ正確なリスク検知、コンプライアンス遵守とデータ保護の両立、AIによる競争力強化。

2. ヘルスケア業界における研究開発支援と患者データ保護

- 課題

医療論文、治験データ、電子カルテ情報(匿名化・仮名化処理後)などをAIで分析し、新薬開発の効率化や診断支援技術の開発を行いたい。

HIPAA(米国医療保険の相互運用性と説明責任に関する法律)や日本の3省2ガイドラインなど、厳格な個人情報保護規制への対応が求められる。

- Geminiとセキュリティ対策の活用

Geminiを用いて医療文献から最新の知見を抽出したり、創薬ターゲットの候補を探索したりする。

データ保護とコンプライアンス

Google CloudのHIPAA準拠環境でGeminiを利用。

CMEKを使用して暗号鍵を厳格に管理。

IAMポリシーにより、データへのアクセス権限を持つ研究者を限定。

データ処理が行われるリージョンを指定。

倫理的配慮

Responsible AIツールキットを活用し、モデルのバイアスや公平性を評価。

患者プライバシーに最大限配慮したプロンプト設計と出力フィルタリング。

- 結果(期待される効果)

研究開発サイクルの短縮、個別化医療への貢献、患者データの厳格な保護と倫理的AI利用の実現。

3. 製造業におけるサプライチェーン最適化と機密情報保護

- 課題

サプライヤーとの契約書、部品仕様書、品質管理レポートなど、企業秘密や機密情報を含む大量のドキュメントをAIで分析し、サプライチェーンの脆弱性特定やコスト削減機会の発見を行いたい。

- Geminiとセキュリティ対策の活用

Geminiのマルチモーダル機能を活用し、契約書のテキスト分析と図面情報の理解を組み合わせ、潜在的なリスク(例:特定のサプライヤーへの過度な依存)を特定。

情報漏洩対策

VPC Service ControlsとPrivate Endpointsでセキュアなアクセス経路を確保。

IAMでドキュメントへのアクセス権限を部署や担当者レベルで細かく制御。

プロンプトエンジニアリング

機密情報がプロンプト経由で意図せず漏洩しないよう、入力プロンプトの設計を工夫し、出力結果を監視。

必要に応じて、機密情報をマスキング処理した上でGeminiに入力。

- 結果(期待される効果)

サプライチェーンの可視性向上、リスク対応力の強化、機密情報を保護しながらの業務効率化。

これらの事例はあくまで一例ですが、Geminiの高度な機能とGoogle Cloudの堅牢なセキュリティを組み合わせることで、様々な業界で革新的なソリューションを安全に実現できる可能性を示しています。

まとめ

本記事では、Google Cloudの最先端AIモデル「Gemini」のセキュリティについて、その基盤となる考え方から具体的な機能、導入ステップ、そして活用事例に至るまでを解説しました。

Geminiは、Googleの長年にわたるセキュリティへの投資とAI研究の成果を結集したものであり、企業がAIの力を活用する上で信頼性の高い選択肢となり得ます。

重要なのは、Geminiが提供する高度なセキュリティ機能も、それを適切に理解し、設定・運用して初めてその真価を発揮するということです。

責任共有モデルに基づき、自社のセキュリティポリシーやコンプライアンス要件と照らし合わせながら、IAM、VPC Service Controls、CMEK、監査ログといった機能を最大限に活用することが求められます。

また、プロンプトインジェクション対策や出力データの検証など、アプリケーションレイヤーでのセキュリティ対策も忘れてはなりません。

セキュリティは一度設定すれば終わりではなく、継続的な監視、評価、改善が必要なプロセスです。

Google Cloudが提供するツールや情報を活用し、常に最新の脅威に対応できる体制を維持することが、Geminiを安全かつ効果的に活用し続けるための鍵となります。

Geminiの導入は、ビジネスに大きな変革をもたらす可能性を秘めています。本記事が、皆様のセキュアなAI活用戦略の一助となり、そのポテンシャルを最大限に引き出すためのお役に立てれば幸いです。

参考文献

- Google Cloud Security (概要):

https://cloud.google.com/security

- Google Cloud Security の概要 (Google Developers & Practitioners Blog):

https://cloud.google.com/blog/ja/topics/developers-practitioners/google-cloud-security-overview

- Google Cloud コンプライアンス リソースセンター:

https://cloud.google.com/compliance

- Google AI の倫理原則:

https://ai.google/responsibility/principles/

- Vertex AI Security:

https://cloud.google.com/vertex-ai/docs/general/vertexai-security-controls?hl=ja

- VPC Service Controls のドキュメント:

https://cloud.google.com/vpc-service-controls/docs/overview

- Customer-Managed Encryption Keys (CMEK):

https://cloud.google.com/kms/docs/cmek

- Cloud Audit Logs のドキュメント:

https://cloud.google.com/logging/docs/audit

コメント